人工知能と倫理

人工知能(Artificial Intelligence – AI)は日々進歩しており、もはや既に私たちの日常に欠かせないものとなりつつある。

一方で、このようなAI技術の発達に対してはSF小説・映画や各界の著名人等からの懸念を表明する声も後を絶たない。

人間はこの先AIとどのようにつきあっていくべきだろうか?

現実の人工知能技術と人型ロボット

そもそも人工知能は現在どの程度進歩しており、どのような場面で応用されているのか、まずはそこから始めたい。

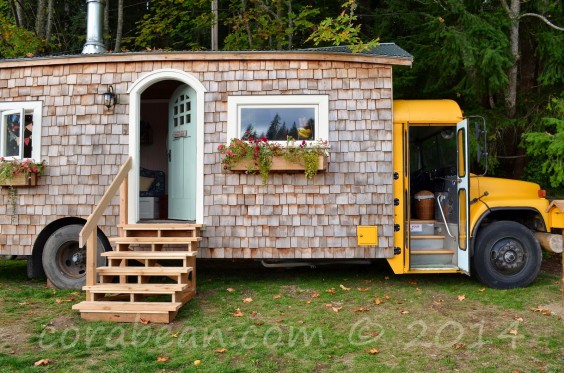

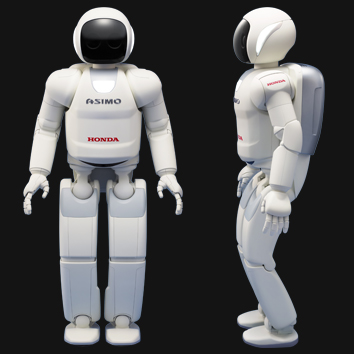

最も分かりやすい例としては、例えばホンダが早くも1986年の時点で発表した「アシモ」(第一号E0)が挙げられるだろう。

via:Honda

via:Honda

この時点での「アシモ」はまだ動きもぎこちなく、とても既存の雇用や人間の存在そのものを脅かすような存在というほどには見えなかった。

ところが現在では「アシモ」以外にも世界各国で人型ロボットが研究・開発されており、アメリカのボストン・ダイナミクス社が開発した「アトラス」などは既に軍用機として実用化できるように改良が進められている。

さながら「ターミネーター」のような未来を予想させる不気味さを感じさせるほど、人工知能は進歩してきるのだ。

ただ、著名な人工知能研究者のデミス・ハサビス氏は現状では近い将来に「ターミネーター」あるいは「スカイネット」レベルの自立性を持つ人工知能の開発は「非常に非現実的」と見ている。

とはいえ、例えばiPhoneに使用されているsiriは自立的に思考するシステムではないとはいえ、これでも既に人間とある程度の「会話」ができるようになっている。

ネット上でも「siriの~という質問に対する答えが怖い」という類の投稿は多数みられる。

人工知能を進歩させて良いのか?

人工知能を恐れているのは何も素朴なiPhoneユーザーだけではない。

著名な科学者の中でも、例えば「車椅子の物理学者」として日本でもよく知られているスティーブン・ホーキング博士は、完全な人工知能の完成は「人類の終焉を意味する」とまで言い切っている。

via:WIRED

via:WIRED

IT業界の大御所ビル・ゲイツ氏も「我々はもっとAIの脅威を案ずるべきだ」と発言しており、これほど知的影響力のある人々まで憂慮しているとなるとこれは決して杞憂ではないかに思える。

実際このような懸念を反映し、日本では既に人工知能学会が倫理綱領を発表している。

科学者の倫理観が生物学や原子力に留まらず、人工知能の分野でも問われるようになってきているのである。

人工知能の権利?

一方で、現代の(特に欧米の)哲学者や思想家の中には、逆にAIにも知的存在としての敬意を払い何らかの権利を与えるべきだという「AIに対する」倫理的義務を主張する意見もある。

こんなことを言うと「AIの権利」とは何か、生物ですらない機械に「権利」を与えるとはどういうことなのか、という疑問を持たれるかもしれない。

しかし「欧米のリベラリズム」は既に男女平等、人間皆平等の次元をとうに超えて、既に動物や植物にまで「人権」の適用を拡大すべきというようなところまで進んでいる。

しかもこのような考えが一般に広く受け入れられているのである。

少々極端に言えば、今のヨーロッパでは単に動物の肉が含まれている食べ物を口にするだけで倫理的罪悪感を感じずにはいられないような雰囲気が常態化している。

この流れの当然の帰結として、一部では文字通り人工知能にも人間同様の権利を与えるべきだという意見が実際に真面目に議論されている。

「ドラえもん」も人間として権利を主張できるようにすべき、という意見だと言えばイメージしやすいだろう。

これに対し、アメリカの法律専門家などはAIが自ら権利の主張を始めることを危惧している。

そうなる前に今から法整備をして来るべき事態に備えるべきだということだ。

つまり、アメリカでは法律家が人間vs人工知能の市民革命戦争を真剣に恐れているのである。

「権利主体」となる為の条件を「人間であること」のみに制限するのは悪しき「人間中心主義」であり「非合理的で厳しすぎる」とされ、「痛みを感じる能力が潜在的にでもあること」あるいは「自立的行動が可能であること」にまで拡大しなければ納得できない西欧のリベラリストは、同様の論理でAIにまで権利を拡大せずにはいられないのである。

もしこのような権利要求を可能にするようなレベルの思考が人工知能によって獲得される、あるいはリベラルな科学者によってプログラムとして与えられるなら、本当に人工知能達が自分たちの「人権」を主張し始めるかもしれない。

人工知能をめぐる二つの倫理的ジレンマ

こうしてみると、人工知能をめぐっては二つの全く異なる次元のジレンマが存在するということがわかる。

ひとつは、より便利な社会を実現するために人工知能を進歩させようと研究に勤しんでいる科学者や技術者の立場と人工知能のもたらす未来を恐れる市民の立場の衝突。

もうひとつは、人工知能が一定水準まで進歩した暁には人工知能にも権利を与えるべきであるというウルトラリベラリズム・超平等主義の立場とより保守的な人間の為の人権という概念に拘る字義通りの意味での「ヒューマニズム」の立場の衝突。

勿論、他にもAIに関する様々な次元での倫理的・法的問題は存在するしこれから新たに生じもするだろう。

だが、上述の二つのジレンマに関しては、既に欧州ではアカデミック哲学において前者については科学哲学の文脈で、後者については応用倫理学の文脈で実際に議論されていることである。

まとめ

最後に、私自身の人工知能に関する倫理的見解を簡単に述べて結論に変えたい。

まず、人工知能開発に関する科学者の倫理について。

人工知能の技術的発達に関して倫理的制約を科学者・技術者に課すことは必ずしも人工知能の将来における脅威を取り除かないと考える。

法や倫理を無視して危険なほどに高度な人工知能を誰かがつくったとしよう。

その人工知能が真に危険なものなのであるならば、その開発が公に知られ開発者が糾弾されるようになるころには既にAIは人類にはもう止められないものになっているだろう。

何故そんなことが言えるかといえば、我々には既に原子爆弾開発の例があるからだ。

真に強力な武器を手にした者にとっては、どんな倫理的非難も空虚なものに過ぎない。

倫理的非難だけで非武装化させることができるほど人間の支配欲は弱くない。

核開発競争が留まるところを知らず、今でも核の拡散が続いているという事実がそのことを物語っている。

もし本当に悲劇を避けたいのであれば、手段としての技術の方に制限をかけるのではなく、人間同士の間の政治的闘争の方を解決する方がかえって現実的であると考える。

次に、人工知能の権利について。

これについては私は権利主体の概念についての再考が必須であると考える。

確かに、リベラリズムは社会思想上の「進歩」であるかもしれないし、リベラリズムが西洋において露骨な人種差別や性差別の克服に大きく貢献したのは事実だろう。

しかし動物はおろか機械にまで「権利」概念を拡大し「被圧マイノリティ」として特別の保護をしようという方向性には何か本末転倒なところがあるという印象を否定できない。

もとより日本には仏教や綱吉将軍の生類憐みの令などの実例が既に存在し、人間を無視する方向に行き過ぎた「慈悲心」がどういう結果を招くかを経験し、かつ克服してきたという歴史がある。

従って特にこの点に関しては、西洋でどんな倫理上の「革命」が起ころうと、日本人が自らの歴史的経験を基に独自の倫理観を持つことに私は肯定的である。

倫理の基本は「倫」という字の人偏に、すなわち「人間」の幸福にあると考える、という考えは確かに普遍的であるよりも特殊東アジア的であるかもしれない。

だが、東アジアで生まれ西洋に見られない思想のすべてが「間違っている」ということを直ちに意味するわけではないと私は考えている。

少なくとも、西洋のリベラリズムを無批判に輸入するだけではなく、それが日本という国においてどのように需要されるべきかという点に留意しつつひとつひとつ詳細に検討するという程度の慎重さがあってもいいのではないだろうか。

ライター:神谷 匠蔵

佐藤 駿 Facebook Twitter

デザインファーム【THE APP BASE株式会社】代表取締役/コワーキングスペース【DEN】管理人/未来の選択肢を共有するWEBマガジン【THINK FUTURE】編集長/欲しいものはつくろう、自分の手で。DIY写真.レシピ共有アプリ【HANDIY】運営

1984年9月27日生まれ。中央工学校建築設計科卒。3姉妹のパパ。

建築業界(現場監督、設計事務所等)→東日本大震災で価値感が大きく変わり、場所に捉われない働き方ができるIT業界へ転身。

起業と同時に東京から長野へUターン。長野でコワーキングスペースDENを始め、地方発の起業家を増やし小さな経済圏を構築、挑戦する人を増やす。

未来の選択肢を共有するWEBマガジン THINK FUTUREで新しいライフスタイルを提供。

スマートフォンアプリのデザインやWEBサービスのUI、UXデザインを主に手がけ、ひいては建築の意匠設計・地域デザイン等、「広義のデザイン(問題を捉える正しい表現を掴む)」と「視覚のデザイン(問題を解決するUI、UXデザイン)」の両面からアプローチするデザインファーム。